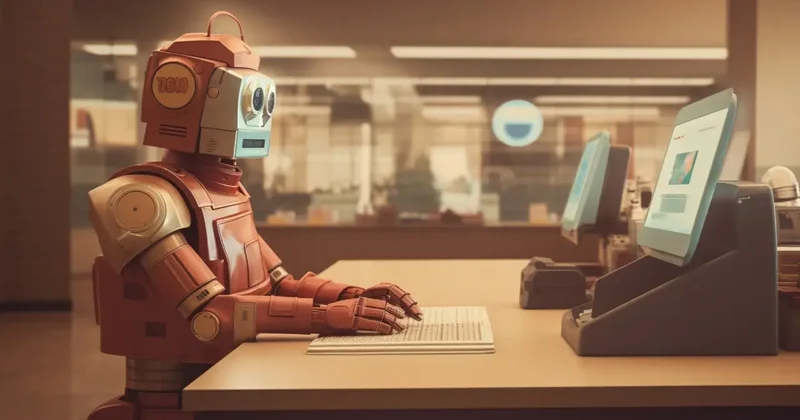

Что такое механизм галлюцинаций и водяные знаки ИИ, или Как распознать сгенерированный нейросетью текст

Согласно информации сайта Informburo.KZ, сообщает Qazaq24.com.

Отличить текст, сгенерированный искусственным интеллектом от написанного человеком, сегодня кажется более простой задачей, чем было на старте массового распространения ИИ. У людей развилась насмотренность. Одни пользователи определяют сгенерированный текст по длинному тире ("–"), другие видят определённые паттерны в словах и предложениях. Однако есть больше неочевидных признаков, которые исследованы казахстанскими и зарубежными учёными.

Почему языковые модели избирают научный и полный канцеляризмов стиль, как его определять и почему нельзя наверняка определить автора текста.

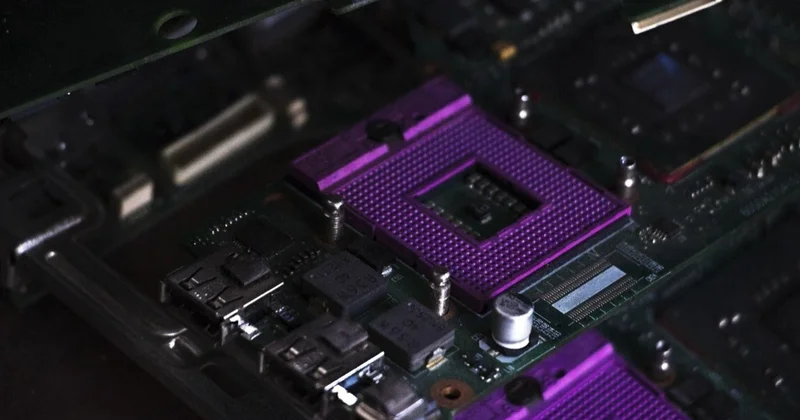

Как обучают искусственный интеллектМногие, доступные широкой публике модели ИИ, например, ChatGPT и Gemini, являются языковыми (LLM). Они обучены на текстах из общедоступных источников: научных статьях, учебных материалах, энциклопедиях, новостных ресурсах, книгах и сайтах. ИИ анализирует огромное количество предложений, фраз и диалогов, на основе чего учится продолжать мысль, объяснять информацию и давать ответы. Так модели способны вести связный диалог, формулировать идеи, объяснять сложные темы и решать задачи.

Однако для полноценного обучения недостаточно просто "скормить" языковой модели большой массив текстов. Как объяснил декан факультета информационных технологий КазНУ имени аль-Фараби, PhD и профессор Тимур Иманкулов, обучение машины происходит сложнее:

"Второй этап – это обучение с участием человека. Специалисты показывают модели правильные ответы, корректируют её поведение, дают примеры того, как нужно общаться с пользователем, как объяснять сложные вещи простым языком, как быть вежливой, корректной и полезной. Это похоже на развитие человека: сначала дают огромную библиотеку знаний, а затем – обучают культуре общения, этике, корректности, эмпатии".

В контексте этого обучения становится понятен механизм галлюцинаций ИИ. Профессор отметил, что это связано с тем, как ИИ генерирует ответ: система просчитывает, какое слово статистически наиболее логично поставить следующим в последовательности.

В некоторых случаях это приводит к выбору слишком "безопасных" и предсказуемых токенов (слов или частей слов), что может спровоцировать зацикливание и повторение одних и тех же фраз. Чтобы избежать такого смыслового ступора, в алгоритмы генерации добавляют специальные элементы вариативности (например, параметр температуры).

Кроме того, проблема создания ложной информации, несуществующих фактов или ссылок часто коренится в самой системе обучения и поощрения. ИИ обучался на том, что полнота ответа важнее, чем его фактическая достоверность или точность источников. Долгое время модели поощряли за то, что они умеют создавать полный и исчерпывающий ответ, а не за то, что они приводят исключительно верифицируемые данные.

Лингвистические признакиГлавный вывод всех исследований – тексты, созданные ИИ, имеют низкое лексическое разнообразие.

С одной стороны, ChatGPT генерирует контент, который использует более скудный набор уникальных слов по сравнению с текстами, написанными человеком. Ограниченный активный словарный запас искусственного интеллекта напрямую вытекает из вероятностного принципа генерации языка. ИИ намеренно избегает менее распространённых синонимов. Хотя они могли бы повысить лексическое разнообразие, их использование несёт риски создать смысловую ошибку. Это отчасти объясняет и злоупотребление эмодзи (смайликами) при генерации контента в разговорах или рекламных жанрах.

С другой стороны, результаты исследований говорят о том, что в сгенерированных текстах гораздо меньше тавтологии и прямых лексических повторов, нежели в написанных человеком. Учёные применяли метрику дисперсии (dispersion), которая измеряет интервалы между повторениями одного и того же слова или однокоренного.

Длина же слов в генеративном тексте остаётся спорным аспектом. В части работ исследователи пришли к выводам, что тексты ИИ состоят из более длинных слов, тогда как другие работы не выявили существенной разницы. Тем не менее, LLM не перенимают человеческую привычку использовать более короткое слово вместо длинного, например, "спс" вместо "спасибо".

В исследовании под названием "Лингвистические характеристики текста, сгенерированного ИИ: Обзор" (Linguistic Characteristics of AI-Generated Text: A Survey) учёные Лука Терчон и Кая Добровольц из Университета Любляны (Словения) и Института Йожефа Стефана, проанализировали и идентифицировали конкретные слова, которые характерны для сгенерированных текстов. А также обнаружили те, которых он избегает.

Чаще всего в текстах, созданных искусственным интеллектом, встречаются служебные слова, такие как модальный глагол can (может), союз and (и), а также предлоги by, with и for. Что касается контентных слов, то ИИ склонен к обобщающей или лексике с неопределёнными группами (others – другие, researchers – исследователи) или формальными описаниями (knowledgeable – осведомлённый, incredibly polite – невероятно вежливый).

Реже всего ИИ использует союзы, которые означают противопоставление или причинно-следственные связи (however – однако, but – но, because – потому что, if – если). Почти полностью отсутствуют личные местоимения первого лица (I – я, my – мой, us – нас/нам), а также глаголы, связанные с чувствами, эмоциями и прямым восприятием (say – говорить, feels like – чувствуется, look – смотреть, hear – слышать). Отдельно учёные отметили, что тексты большинства популярных ИИ практически лишены агрессивных или грубых выражений. Но есть и исключения, например, DeepSeek.

Грамматические и стилистические признакиПоследовательность слов в предложении также выступает косвенным маркером, когда ИИ строго придерживается порядка слов: Субъект – Глагол – Объект (SVO). Это особенно характерно для английского и испанского языков. Обычные авторы используют более разнообразную структуру, включая инверсии (обратный порядок слов). Главный маркер сгенерированного текста – это злоупотребление сложными синтаксическими конструкциями, в частности, причастными и деепричастными оборотами.

Статистика исследований показывает, что языковые модели используют причастные и деепричастные обороты (аналог в английском языке – Present Participial Clauses) в 2–5 раз чаще, чем человек. Объяснить, зачем машина избирает данный путь, достаточно просто: вместо того, чтобы написать два простых предложения, ИИ сжимает два действия в одно, чем уплотняет текст. Поэтому пользователь в сгенерированном тексте чаще наблюдает такие конструкции:

"Боксёр, опираясь на свою ловкость и уклоняясь от тяжёлых ударов, танцует вокруг ринга".

"The boxer, relying on his agility and dodging heavy blows, dances around the ring".

ИИ-тексты задействуют больше существительных и предлогов, но при этом меньше наречий и прилагательных. В англоязычных научных трудах это дали название – "феномен номинализации", когда ИИ преобразовывает глаголы или прилагательного в отглагольные существительные или отприлагательные существительные. Например, "любовь" вместо "любить", "счастье" вместо "быть счастливым", "повышение" вместо "повышать".

Номинализация в текстах ИИ часто выполняет ту же функцию, что и пассивный залог: она скрывает, кто именно совершает действие. Этот приём часто применяют в научных текстах, когда необходимо говорить о темах обобщённо и формально, однако для обычного читателя такие тексты тяжелее для восприятия.

Сложность обнаружения сгенерированных текстовДо того, как сгенерированные тексты стали массовым явлением, различные тексты проверяли на авторскую принадлежность и плагиат. Для этого в науке развилась отдельная область – стилометрия, которая занимается количественным анализом авторского стиля: частоты слов, длины предложений и использования определённых конструкций. Её также применяют для обнаружения следов генеративной модели.

Разработаны и специальные программы, которые пытаются выявить сгенерированные тексты, анализируя их структуру, стиль и предсказуемость слов. Однако, несмотря на все усилия, эти методы не являются точным инструментом для надёжного обнаружения:

"Иногда они ошибаются: текст человека принимают за ИИ и наоборот. Поэтому говорить о стопроцентной надёжности пока рано. Кроме того, существует идея невидимых водяных знаков, которые можно встроить в текст, чтобы потом подтвердить его происхождение. Однако сейчас это тоже не идеальный метод: стоит человеку немного переписать текст, сократить или перевести, и следы исчезают. Исследования продолжаются, но пока это лишь развивающееся направление," – объяснил Тимур Иманкулов.

Подавляющее большинство исследований сосредоточено на английском языке. Анализу русскоязычных текстов, а тем более казахского языка, уделяется крайне мало внимания. Именно поэтому для Казахстана сейчас важно не только использовать зарубежные технологии, но и развивать свои.

"В КазНУ имени аль-Фараби проводят исследования в области искусственного интеллекта, и один из ключевых проектов – это развитие большой языковой модели KazLLM. Проще говоря, это наша версия крупной интеллектуальной системы, которая понимает особенности языка и культуры казахского народа, и будет полезна именно для наших задач: от образовательных сервисов до государственных цифровых решений и бизнеса," – добавил учёный.

Он также считает, что в вопросах новых технологий важно не наблюдать со стороны, а участвовать – строить свои решения, формировать свою экспертизу и вносить вклад в мировую научно-технологическую повестку.

Другие новости на эту тему:

Другие новости на эту тему: Просмотров:155

Просмотров:155 Эта новость заархивирована с источника 04 Декабря 2025 18:58

Эта новость заархивирована с источника 04 Декабря 2025 18:58

Войти

Войти

Новости

Новости Погода

Погода Магнитные бури

Магнитные бури Время намаза

Время намаза Драгоценные металлы

Драгоценные металлы Конвертор валют

Конвертор валют Кредитный калькулятор

Кредитный калькулятор Курс криптовалют

Курс криптовалют Гороскоп

Гороскоп Вопрос - Ответ

Вопрос - Ответ Проверьте скорость интернета

Проверьте скорость интернета Радио Казахстана

Радио Казахстана Казахстанское телевидение

Казахстанское телевидение О нас

О нас

Самые читаемые

Самые читаемые